Manche Vorhaben sind dermaßen komplex, dass man froh sein sollte, überhaupt eine funktionierende Strategie zu haben. Warum es sich trotzdem lohnen kann, ausgetretene Pfade zu verlassen, demonstriert der heutige Blog-Beitrag.

In unserem Beispiel nehmen wir an, dass ein Unternehmen neu auf der Bildfläche erscheinende Interessenten in treue Dauerkunden verwandeln möchte. Hier handelt es sich um ein typisches Beispiel der Prescriptive Analytics: Mögliche Aktionen sollen vorausschauend bezüglich des zu erwartenden Erfolges bewertet werden.

In unserer Modellwelt bewegt sich der Kunde zwischen Zuständen, die als dem Unternehmen bekannt angenommen werden. Verschiedene Maßnahmen stehen dann jeweils zur Verfügung, die den Kunden möglicherweise in einen anderen Zustand versetzen können. Ziel ist es natürlich, eine solche Maßnahmenkette anzuwenden, die letztendlich den Kunden in einen Fan verwandelt.

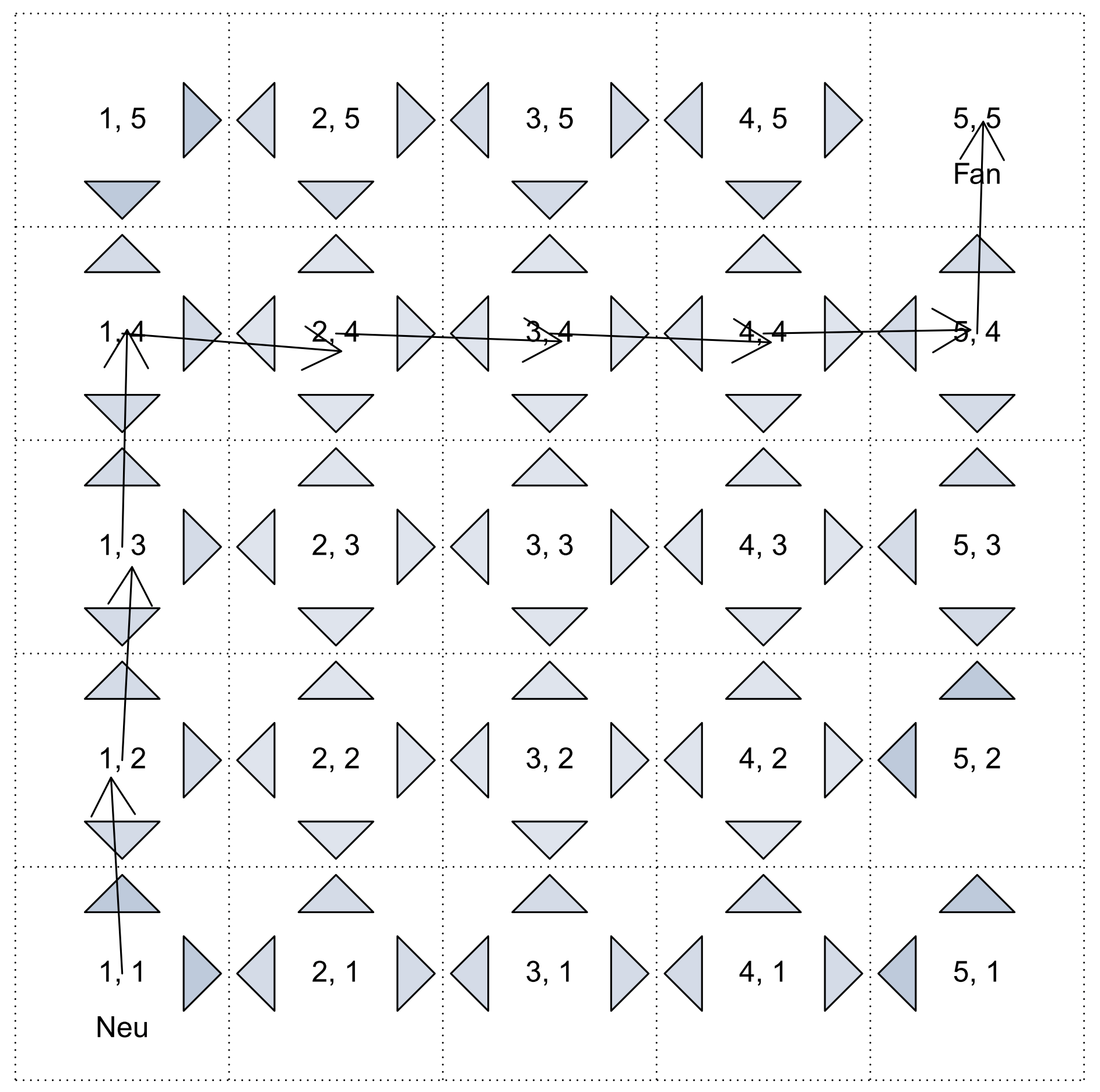

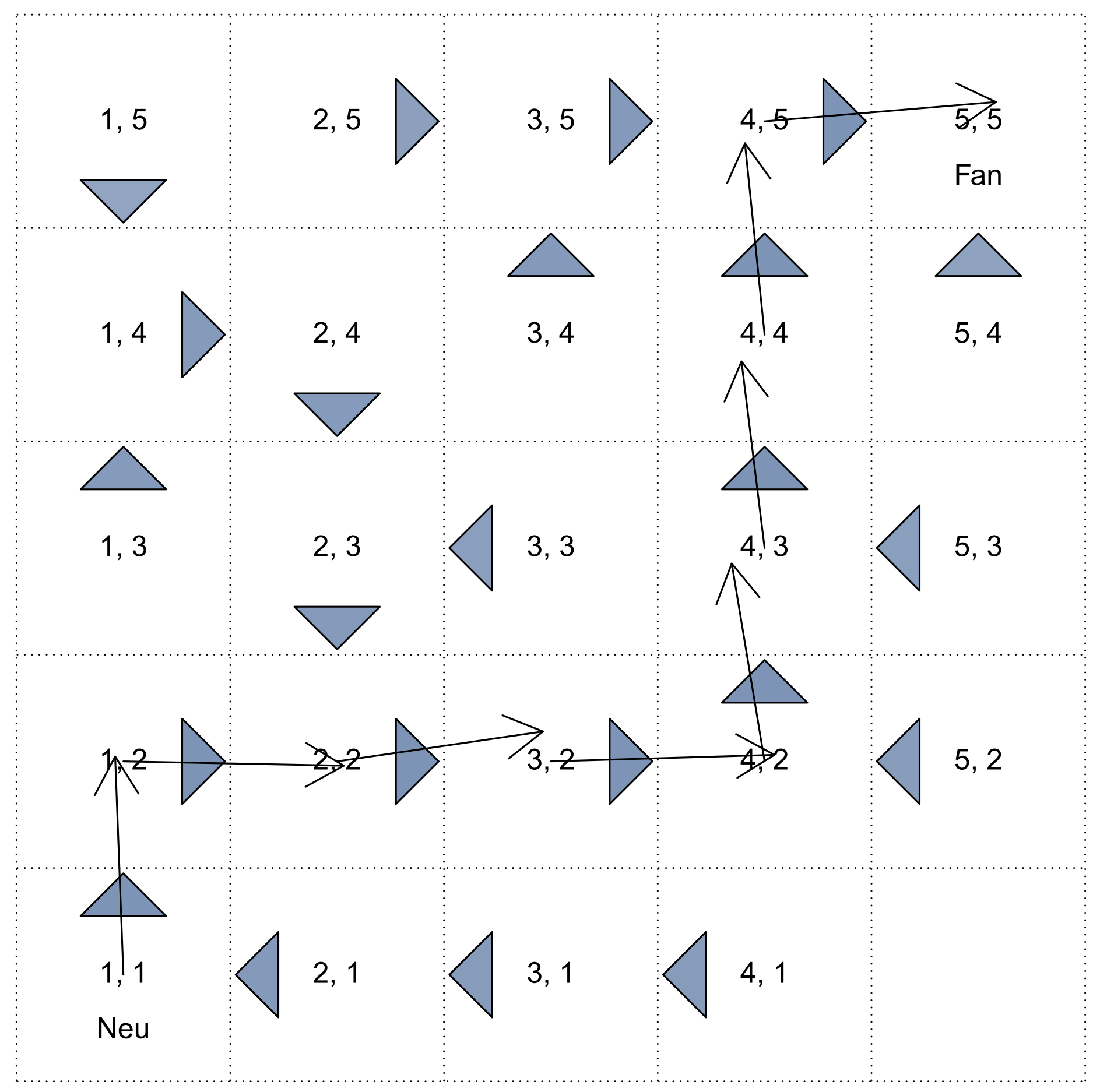

Um die Modellannahmen besser verstehen zu können, nehmen wir vereinfachend an, dass es 25 mögliche Zustände gibt, die sich auf einem 5 x 5 – Raster anordnen lassen. Links unten ist der Neukunde zu sehen, landet er rechts oben im Eck, ist das Ziel erreicht und ein Fan gewonnen worden.

Eine erfolgreiche Customer Journey

Jeder Zustand ist also durch ein Kästchen gegeben und ergriffene Maßnahmen können den Kunden möglicherweise in eines der direkt angrenzenden Nachbarfelder bewegen. Eine Strategie (engl. policy) zu haben bedeutet, für jeden Zustand Wahrscheinlichkeiten für die jeweils möglichen Aktionen anzugeben. Hat man für einen gegebenen Zustand eine Aktion generiert, so landet man mit einer bestimmten, vom Ausgangszustand und der Aktion abhängigen Wahrscheinlichkeit in einem der anderen Zustände.

Oben in unserem Beispiel sei angenommen, dass die Aktionen deterministisch vom jeweiligen Feld abhängen. d. h. die gesamte zur Verfügung stehende Wahrscheinlichkeit sei in einer Aktion konzentriert. Hier sei weiterhin vereinfachend angenommen, dass dann die gewählte Aktion mit hoher Wahrscheinlichkeit zu einem eindeutigen neuen Zustand führt und mit der Restwahrscheinlichkeit verpufft und den Zustand nicht verändert.

Nehmen wir nun an, dass die verantwortliche Person irgendwann einmal eine funktionierende Folge von Aktionen gefunden hat, die sicher einen Fan generiert und seitdem an der Vorgehensweise nichts mehr geändert hat. Dieser Pfad ist in der obigen Grafik eingetragen. Im Ausgangsfeld (1,1) gebe es beispielsweise zwei mögliche Aktionen, die wir hier der Einfachheit N und E nennen. Hier wurde die Aktion N verwendet, die mit recht hoher Wahrscheinlichkeit zum Zustand (1,2) führt. Falls nicht, wird sie solange wiederholt, bis der Übergang stattfindet.

Dann wird eine weitere von 3 möglichen Aktionen (N, E, S) gewählt – hier das N – und falls sich ein neuer Zustand einstellt, lautet dieser immer (1,3). Diese Aktion N kann eine andere sein als das N vom Ausgangsfeld. Mögliche Warteschleifen in einem Zustand sind in der Grafik nicht eingezeichnet.

Wieso wählt die entscheidende Person aber nicht einen kürzeren Pfad von Ausgangsfeld zum Ziel? Dies liegt daran, dass diese globale Vogelperspektive dem Entscheider gar nicht vorliegt. Aus der Sicht der verantwortlichen Person sollte man sich eher ein nebliges, unwegsames Gelände vorstellen, in dem man ohne Kompass unterwegs ist und gerade noch die Optionen der Wegfortsetzung wahrnehmen, aber keinesfalls bereits am Start das Ziel erahnen kann. Der Kollege hat nun einen Weg gefunden, ohne dass er hinterher genau sagen kann, wo er sich auf der Karte befunden hat.

In dem eingezeichneten Pfad gibt es 14 Übergänge. Nehmen wir einmal an, dass eine Aktion in 70 % der Fälle tatsächlich zum gewünschten Übergang führt, so braucht es im Schnitt 20 Schritte, bis das Ziel erreicht wird (hier liegt die sogenannte Negativ-Binomialverteilung zugrunde!).

Solange die Person strikt an der bisherigen Strategie festhält, wird sie aber auch keine bessere finden.

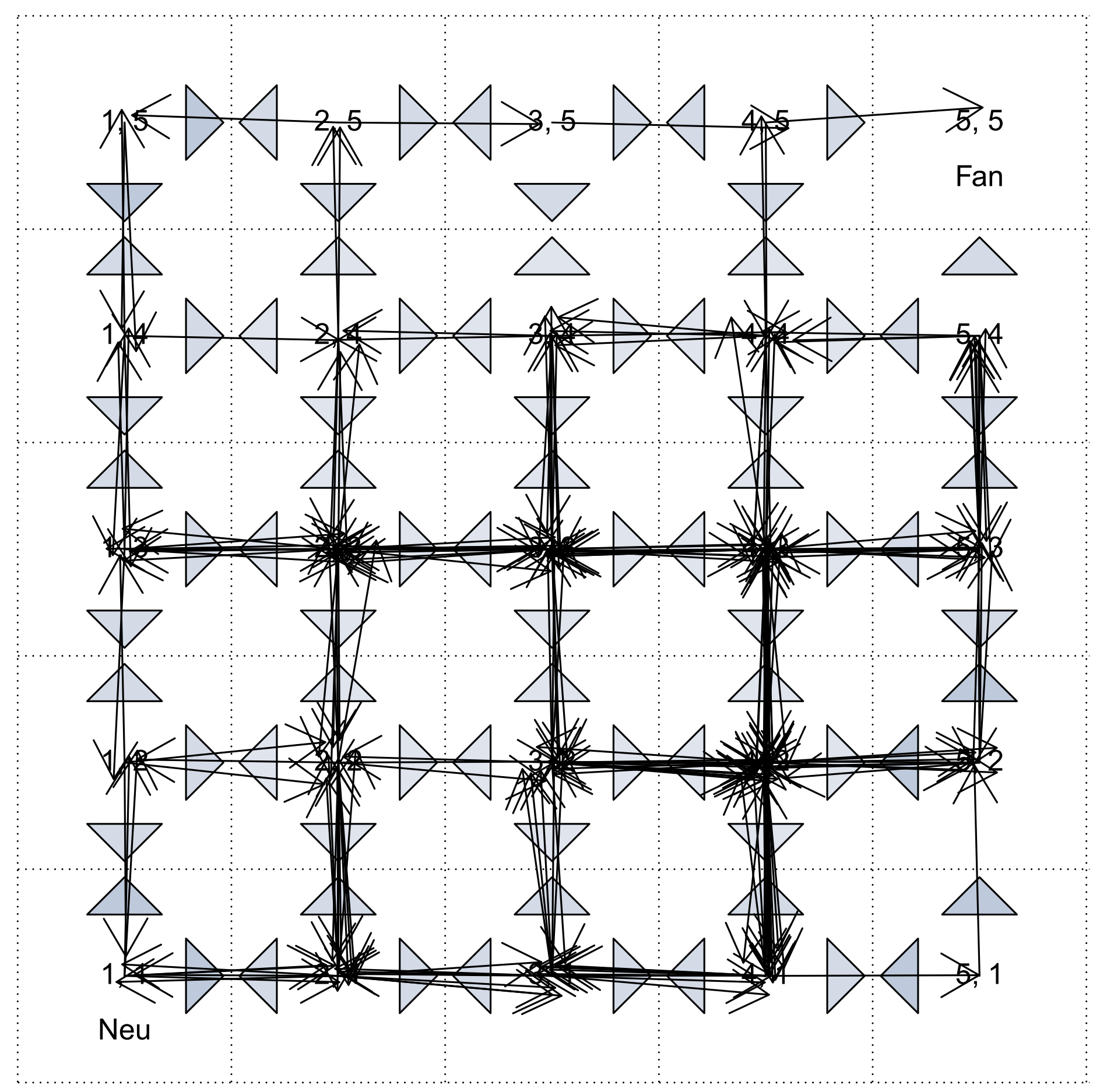

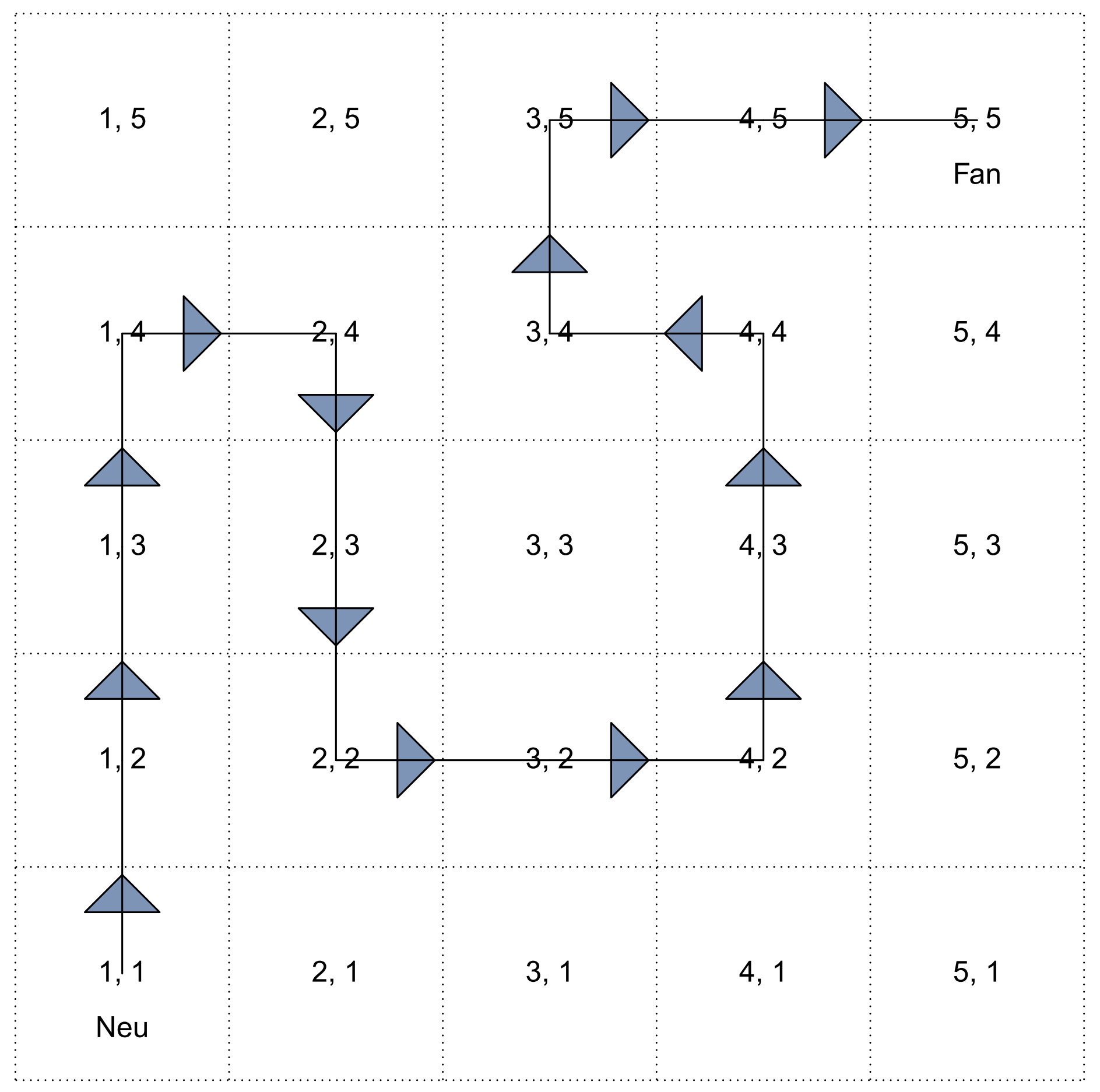

Das genaue Gegenteil wäre eine Strategie, die alle Möglichkeiten konsequent auslotet. In jedem Zustand seien die möglichen Aktionen als gleichwahrscheinlich gewählt. Im Ausgangsfeld seien es beispielsweise N und E mit jeweils 1 / 2 und im Feld darüber N, E und S mit jeweils 1 / 3. Mit einer solchen Strategie kann man Glück haben und sofort einen Weg finden, einen Kunden in einen Fan zu konvertieren, wie dieses Bild zeigt:

Es besteht aber auch die Möglichkeit, sich hoffnungslos zu verfransen:

Hier ist das grundsätzliche Dilemma zu finden: Sollte man mit seiner halbwegs funktionierenden Strategie zufrieden sein und diese ausnutzen („Exploitation“) oder versuchen, neue Wege zu finden („Exploration“)? Das letzte Beispiel ist ein Paradebeispiel für eine gelungene Exploration, da wirklich jeder mögliche Zustand besucht wurde.

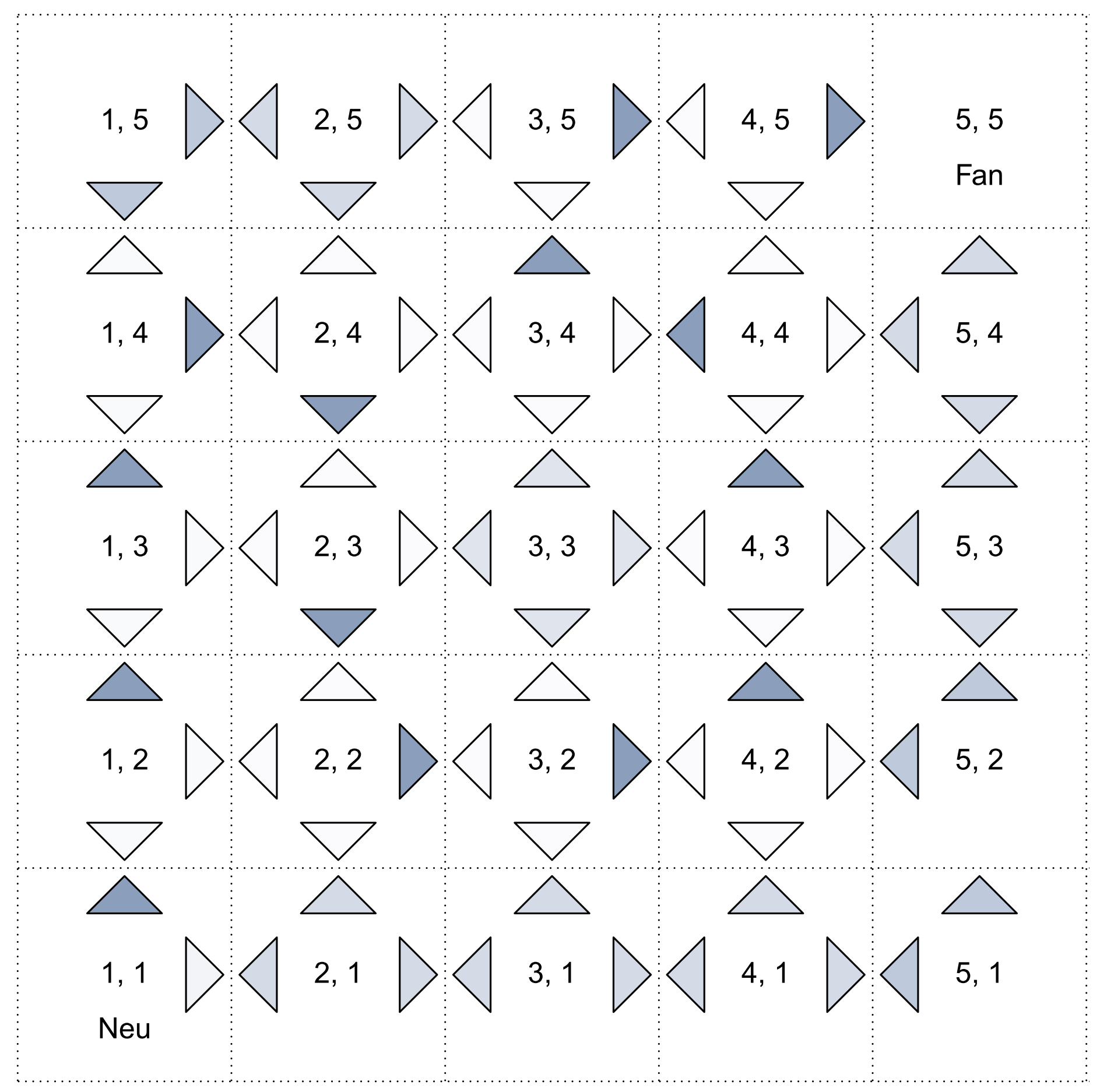

Die Verfahren des Verstärkenden Lernens (gebräuchlicher: Reinforcement Learning) versuchen nun, das Beste beider Welten zu vereinen. In unserem Beispiel wäre es z.B. möglich, mit dem Vorwissen einer erfolgreichen Strategie zu starten, aber von dieser ausgehend Änderungen zuzulassen. Die Initialisierung könnte folgendermaßen aussehen:

Die in der ursprünglichen Strategie verwendete strikte Verwendung einer Aktion wird initial ersetzt durch ein Vorgehen, diese Strategie zwar meistens anzuwenden, aber eben nicht immer. Hier sei angenommen, dass zu Beginn die Aktion der Ursprungsstrategie mit jeweils 90% gewählt wird, mit den restlichen 10% aber eine beliebige der möglichen Aktionen. Für noch nicht besuchte Zustände seien zunächst alle möglichen Aktionen gleichwahrscheinlich.

Hier ist aber noch nicht Schluss des Ansatzes. Es gibt verschiedene Verfahren, die Strategie in jedem Zustand adaptiv anzupassen. Wir versuchen es hier mit Q-Learning.

Grob gesagt versucht man, einer Aktion, die in einem bestimmten Zustand gewählt wird, einen Zielwert zuzuweisen, der auch zukünftige Ereignisse berücksichtigt. Mit jedem Übergang von einem Zustand zu einem anderen wird der Zielwert des älteren Zustandes in Verbindung mit der gewählten Aktion geringfügig in Richtung Zielwert des neueren Zustands mit der zugehörigen, momentan optimalen Aktion adaptiert.

Bei uns ist der Zielwert mit dem abgezinsten Gesamtaufwand verbunden, der bis zur Transformation des Kunden in einen Fan entsteht, wobei angenommen wird, dass jede Aktion einen Aufwand von 1 erzeugt. Insgesamt möchte man natürlich den Aufwand minimieren, also möglichst schnell das Ziel erreichen.

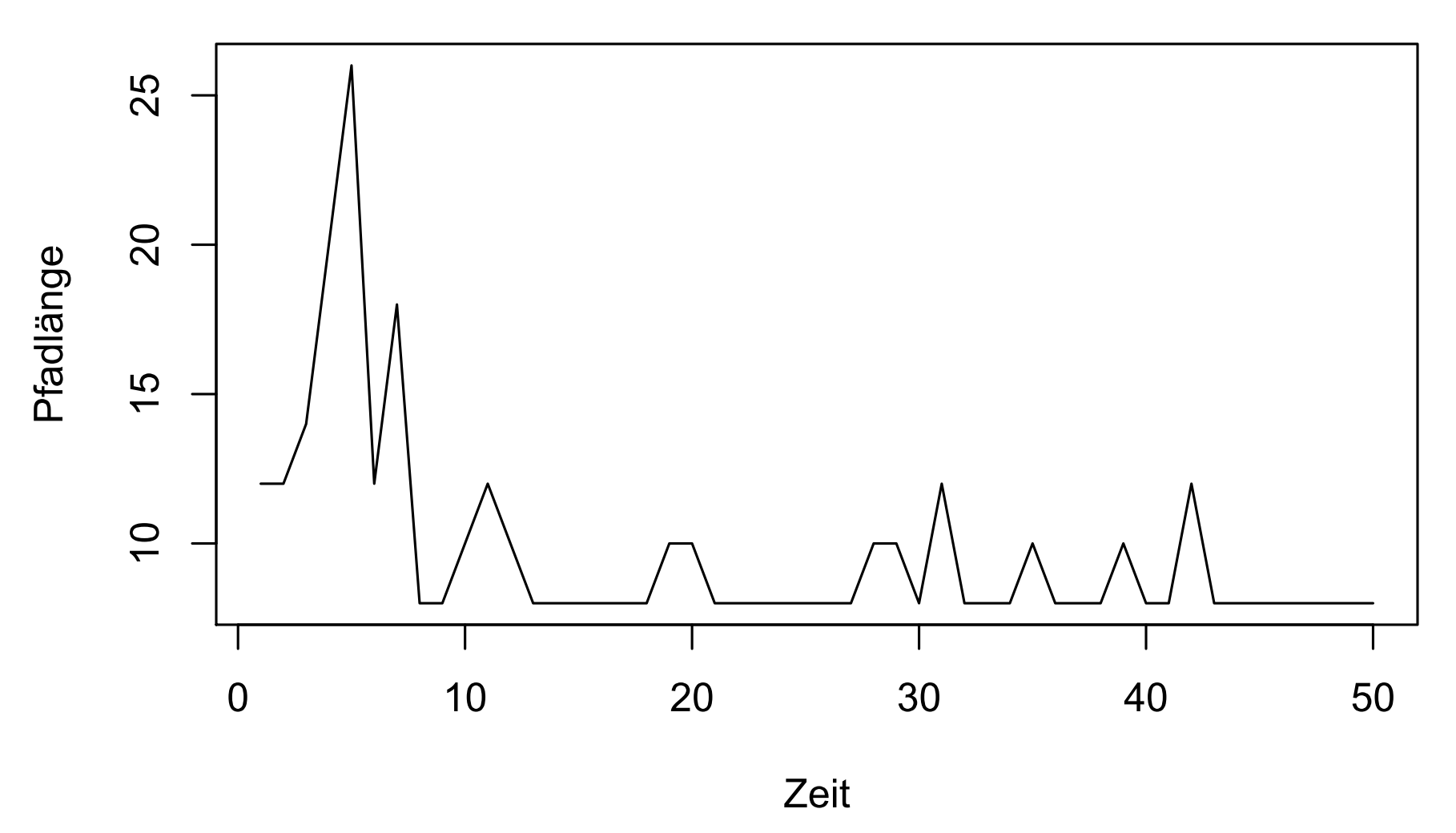

Insgesamt verfolgen wir 50 Kunden bis zum Fanstatus. Die anfänglichen 10%, mit denen Aktionen zufällig erzeugt werden, fahren wir von Kunde zu Kunde langsam auf 0 zurück. Ansonsten wählen wir immer die Aktion, mit der der momentan geringste vorhergesagte Aufwand verbunden ist.

Durch das Zulassen zufälliger Aktionen sind neue Entdeckungen möglich, wie beispielsweise die folgende Abkürzung.

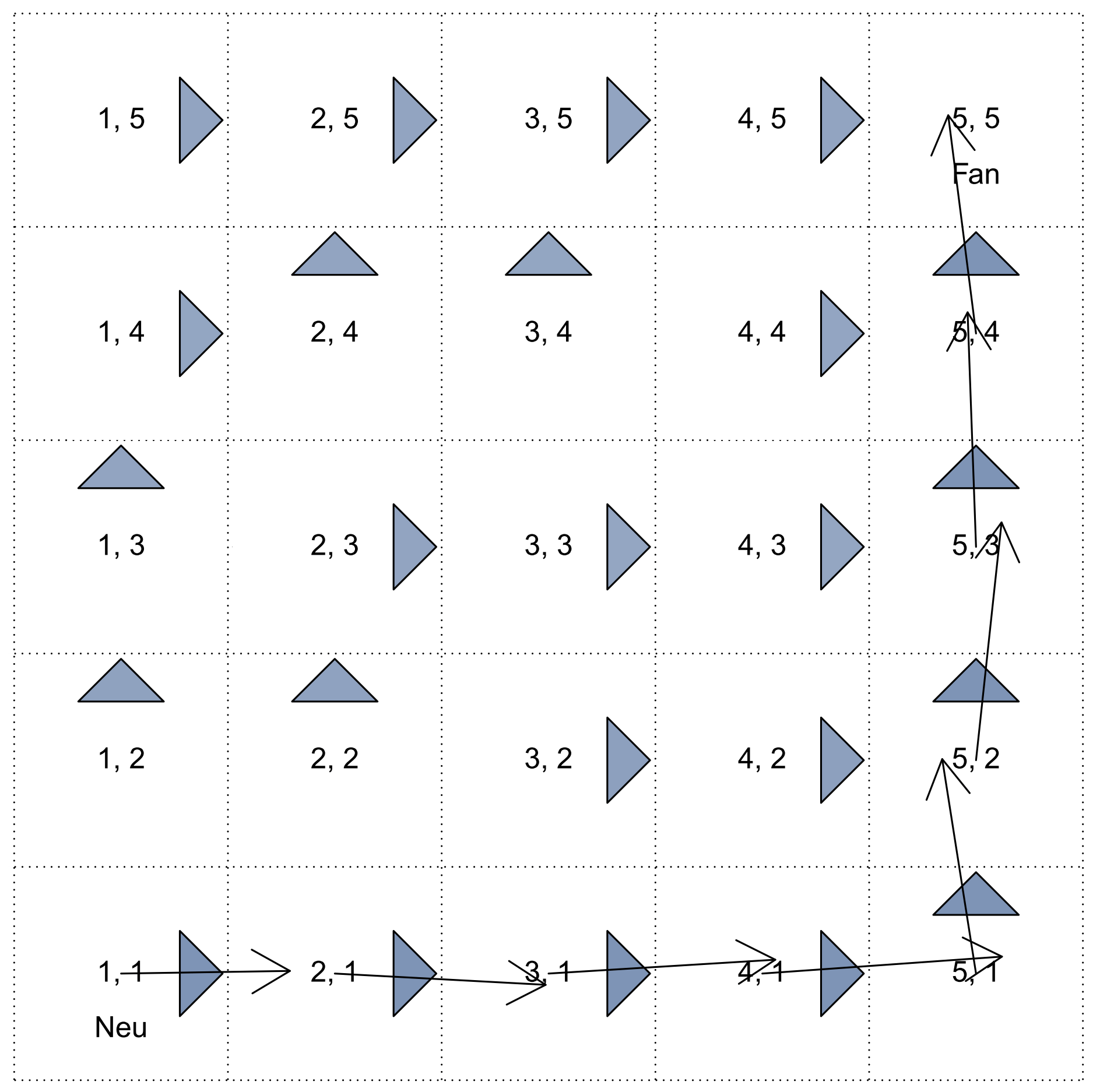

Im obigen Durchlauf wurde durch das erlaubte Abweichen von der Ausgangsstrategie die Existenz eines kürzeren Weges von Position (1,1) nach (2,2) erkannt. Nach 50 Kunden wählen wir pro Zustand die Aktion, die innerhalb des Q-Learning-Ansatzes am vorteilhaftesten ist, also mit dem laut Verfahren geringsten Aufwand verbunden ist. Den abgelegenen Zustand (5,1), der von keinem der 50 Kunden besucht wurde und uns somit eigentlich weiterhin unbekannt ist, haben wir aus der Grafik entfernt:

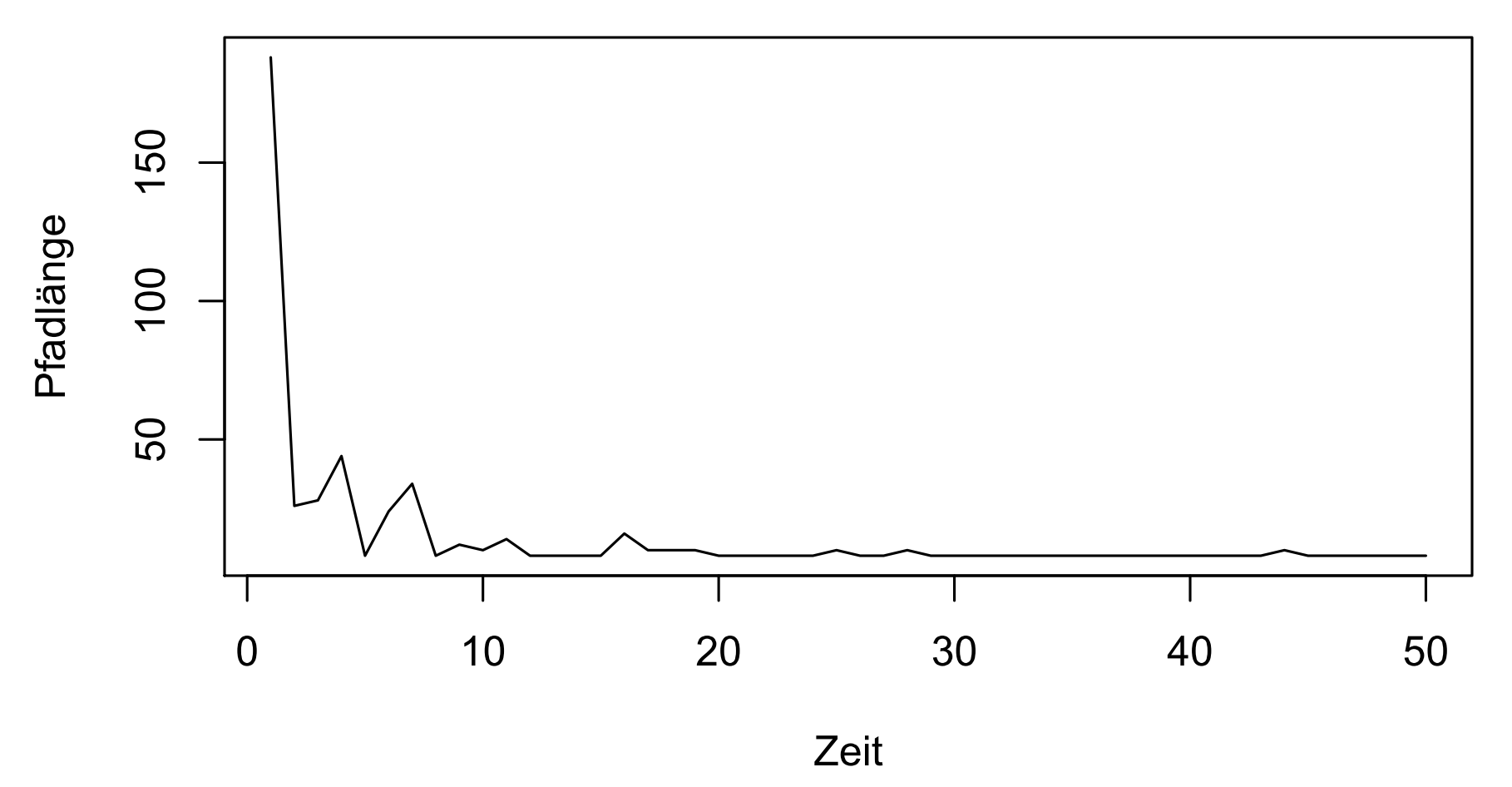

Hält man sich an diese Strategie, gibt es nun nur noch 8 Übergänge vom Start- bis zum Zielfeld. Die folgende Grafik zeigt die Anzahl der Übergänge (ohne Verweilen auf derselben Position) für unsere 50 Kunden.

Die Entwicklung der Anzahl der Übergänge

Zur Erinnerung: In der ursprünglichen Strategie waren es 14 Übergänge. Da wir Exploration zulassen, braucht einer der ersten Kunden auch einmal 26 Schritte, aber dieses vorübergehende Loslassen der eingefahrenen Strategie lohnt sich auf Dauer. Wir wir aus der Vogelperspektive beurteilen können, haben wir eine der mehreren möglichen optimalen Strategien gefunden, die in nur 8 Übergängen den Neukunden in einen Fan verwandeln.

Aktionen für Zustände, die nun nicht auf dem Pfad liegen, sind noch nicht optimal, dazu müsste die Explorationsphase noch verlängert werden. Sollte der Kunde aber durch unvorhergesehene externe Ereignisse vom Pfad geworfen werden, ist die gefundene Strategie immerhin selbstkorrigierend in dem Sinne, dass der Kunde von jedem Feld wieder auf den Pfad der Erleuchtung zurückgeführt wird und nicht etwa in einer Endlosschleife landet.

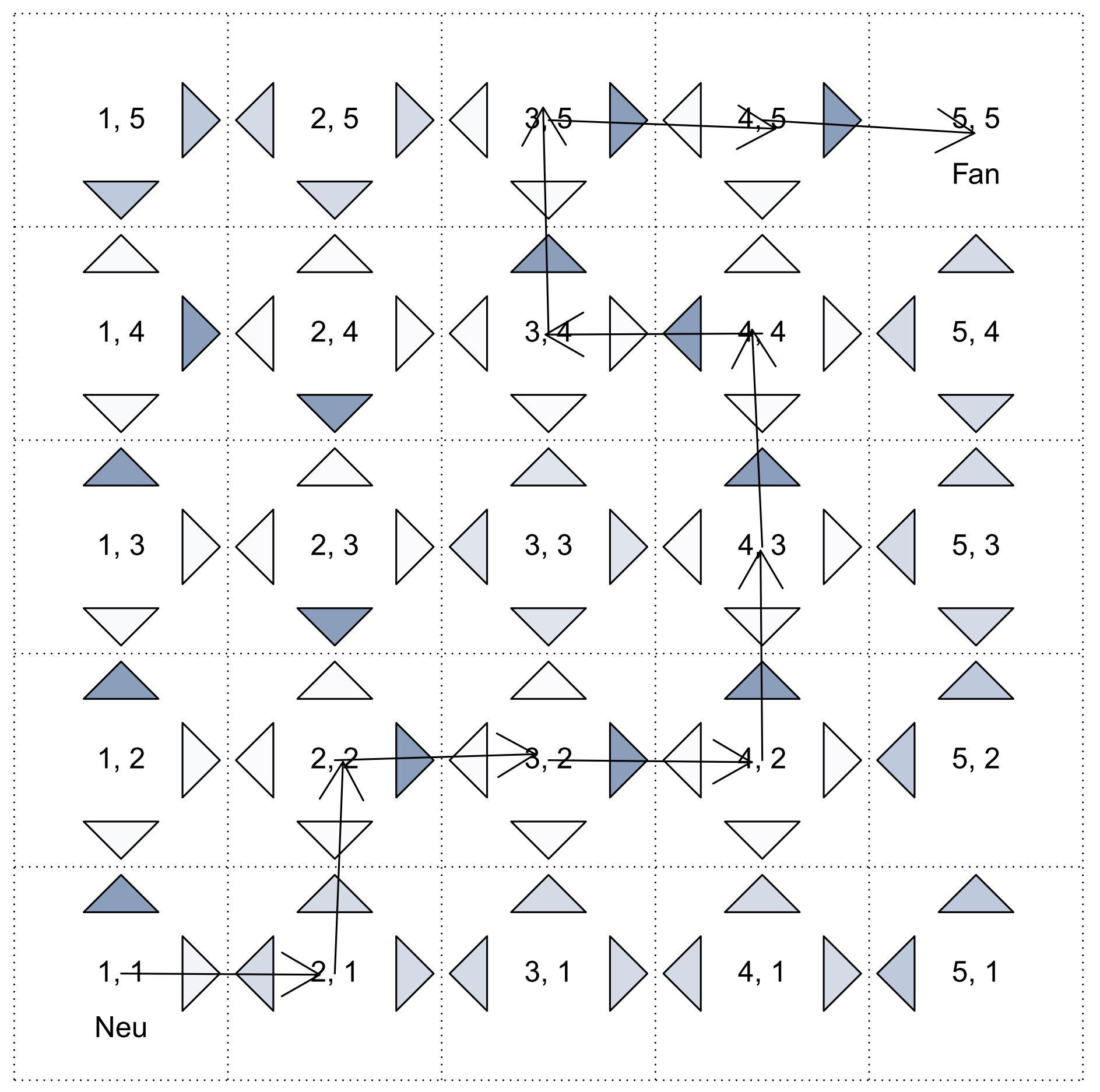

Wir könnten auch die alte Strategie komplett ignorieren und mit einer rein zufälligen Strategie starten. Nach 50 Kunden hat sich das folgende Bild ergeben:

Optimales Verhalten bei rein zufälliger Initialisierung

In der Tat gelangt man nach 50 Kunden zu einem optimalen Pfad, darüberhinaus sogar zu einer global optimalen Strategie, sollte der Pfad durch externe Störungen verlassen werden. Sämtliche Aktionen, auch außerhalb des Pfades zeigen auf direktem Weg zum Ziel, d. h. nach rechts oder nach oben.

Nach Anlaufschwierigkeiten das optimale Verhalten erlernt!

Es gibt einen kleinen Wermutstropfen: Der erste Kunde irrt zunächst mit 188 Übergängen etwas planlos herum – aber dann bringt jeder weitere Kunde enorme Lernfortschritte.

Letztendlich hat der vorübergehende Verzicht auf allzu starre Vorgaben zu einem langfristig vorteilhaften Vorgehen geführt.